Si llevas un tiempo trasteando con asistentes de inteligencia artificial, seguro que te has topado alguna vez con su mayor talón de Aquiles: la falta de memoria a largo plazo. Le enseñas a hacer algo complejo hoy, le das el contexto perfecto, y a la semana siguiente parece haberlo olvidado por completo. Una auténtica pesadilla.

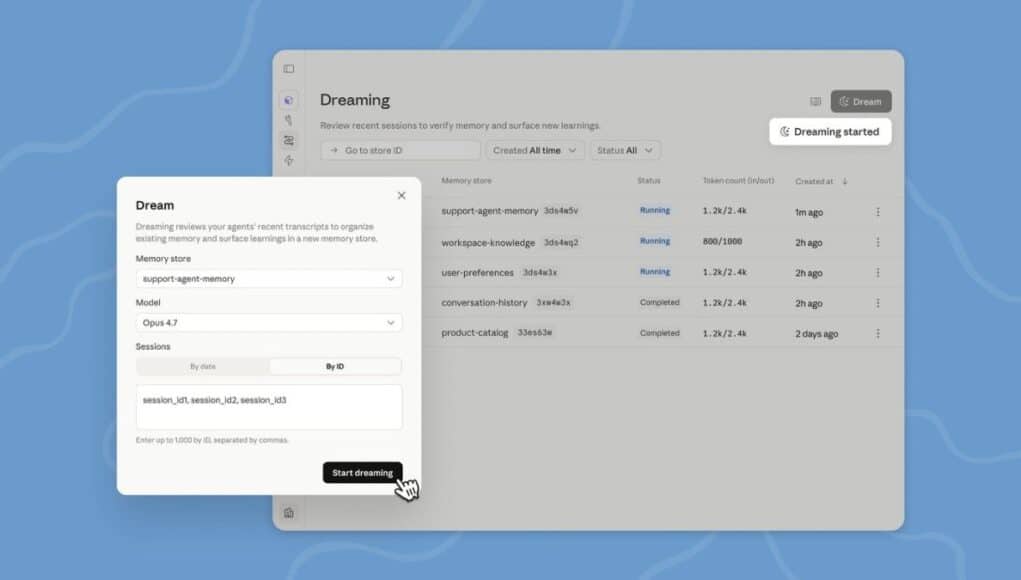

Pues bien, parece que Anthropic acaba de dar con la tecla exacta para solucionar este embrollo técnico. La compañía ha lanzado una interesantísima vista previa de investigación con una función inédita dentro de sus Claude Managed Agents, y la han bautizado de una forma bastante poética: “dreaming” (soñando, en español).

De buenas a primeras, la premisa puede sonar un poco a película de ciencia ficción, pero los datos técnicos que arrojan son extremadamente pragmáticos. Estamos ante un sistema diseñado para que los agentes de IA analicen sus sesiones pasadas de forma autónoma, aprendan de ellas y mejoren su rendimiento continuamente. Sin que tengas que estar llevándolos de la mano.

Las máquinas también «sueñan» para no repetir errores

Y la realidad es que la arquitectura detrás de esta novedad es pura lógica computacional bien ejecutada. Esta nueva función programa revisiones periódicas de la memoria del agente. Durante ese tiempo de «sueño» o inactividad, el modelo de IA se dedica a extraer patrones útiles, detectar fallos recurrentes y reorganizar toda la información que ha ido procesando.

También te puede interesar:Claude podría Obtener el modo de investigación multiagente con memoria y delegación de tareasDicho en plata, es como si Claude se sentara a repasar los apuntes del día antes de irse a dormir para asentar los conocimientos. El objetivo final es garantizar una mejora continua en la precisión a largo plazo del comportamiento de estos agentes. Un salto cualitativo brutal.

Lo más interesante para el sector es la tremenda flexibilidad que otorga a los creadores de software. Los desarrolladores pueden configurar este sistema para que lance actualizaciones automáticas y desatendidas, o bien exigir una revisión manual estricta si prefieren no soltar el volante por completo. Tú decides cómo evoluciona el aprendizaje de tu herramienta.

Criterios de éxito milimétricos y trabajo en equipo

Como era de esperar, la actualización no se queda solo en sesiones de auto-análisis nocturno para algoritmos. A esto hay que sumarle la llegada de los “outcomes”. Hablamos de un sistema paralelo que permite definir criterios de éxito completamente explícitos para cualquier tarea que le encomiendes al modelo.

También te puede interesar:Claude podría Obtener el modo de investigación multiagente con memoria y delegación de tareasBásicamente, se acabó eso de pedirle algo a un LLM y cruzar los dedos para que entienda qué consideramos un trabajo bien hecho. Ahora le marcas la línea de meta exacta. Si la cruza cumpliendo tus parámetros estructurados, la tarea consta como exitosa. Así de simple.

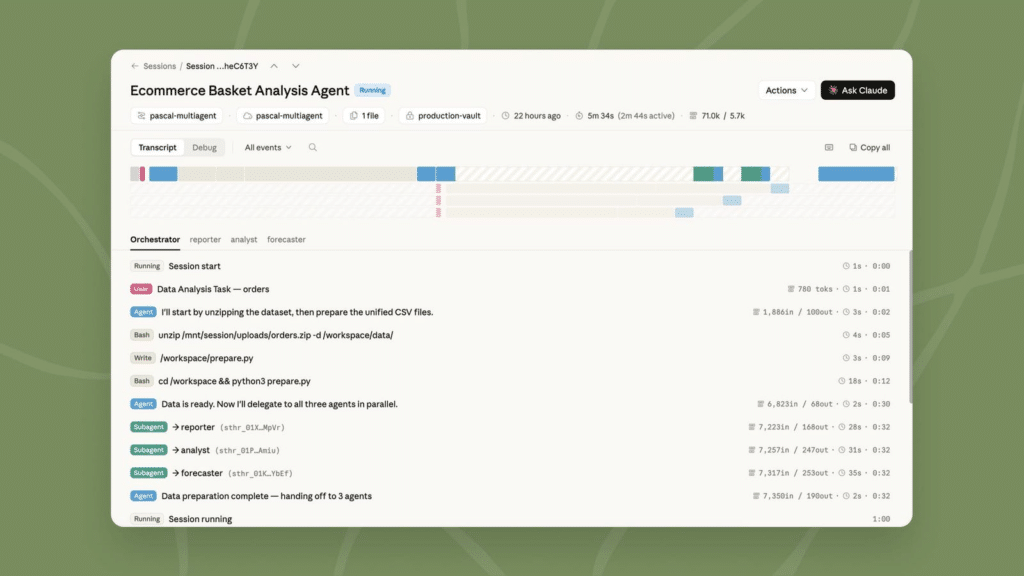

Por si esto fuera poco, Anthropic ha pisado el acelerador integrando la orquestación multiagente. Esta virguería facilita enormemente la delegación de procesos hipercomplejos. Puedes tener un equipo de pequeños agentes especializados, cada uno experto en su nicho, pasándose la pelota de forma fluida hasta completar un flujo de trabajo mastodóntico.

De la teoría a la empresa: el impacto real

Lógicamente, todo este despliegue de artillería pesada está pensado para un público muy específico y exigente. Anthropic tiene en el punto de mira a los desarrolladores empresariales, esos que necesitan gestionar pipelines densos de forma autónoma y sin que el sistema colapse a la primera de cambio.

Actualmente, todas estas capacidades ya están operativas en la plataforma para aquellos desarrolladores que soliciten acceso a la fuente del proyecto y sean aceptados en esta fase de prueba. Aún no es un despliegue global abierto, pero marca la hoja de ruta clara de la compañía.

Si miramos los primeros casos de uso en el mundo real, las cifras invitan a sacar el champán. Los usuarios pioneros en sectores donde no hay margen de error, como la redacción legal, el análisis masivo de registros de servidores o el control de calidad de documentos, ya están reportando una subida espectacular en sus métricas.

En la práctica, esto se traduce en un incremento clarísimo en las tasas de éxito de las tareas complejas y una eficiencia nunca antes vista en la automatización de escritura. Las compañías están logrando un control granular de la memoria que, sencillamente, no existía en las versiones anteriores de Claude ni en gran parte de sus rivales directos.

Al final del día, lo que estamos presenciando es la cimentación de sistemas de inteligencia artificial mucho más fiables y controlables. Una IA capaz de auditarse y mejorarse a sí misma de forma robusta. La pelota está ahora en el tejado de OpenAI y Google; veremos cómo y cuándo deciden responder a este órdago.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.