¿Te imaginas que tu asistente de código pudiera ver exactamente lo mismo que tú cuando depuras una app fuera de tu editor? Pues deja de imaginar. Google ha metido la directa con Antigravity, su ambicioso IDE centrado en agentes que vio la luz en noviembre de 2025 junto al brutal lanzamiento de Gemini 3. Tras unos meses donde la comunidad pedía a gritos más flexibilidad, los de Mountain View han tomado nota. Y lo han hecho a lo grande.

El motivo es simple: no querían dejar que sus competidores les ganaran la partida en la personalización de los flujos de trabajo. En las últimas versiones de la herramienta han empezado a asomar dos capacidades experimentales que cambian por completo cómo interactuamos con el código. Una auténtica locura. No hablamos de simples retoques visuales, sino de funciones pesadas que atacan directamente los históricos puntos débiles de este entorno de desarrollo.

Ojos en la pantalla: el agente sale de su jaula

Si miramos el día a día de un programador, el principal cuello de botella de la IA actual es su ceguera funcional. Hasta el momento, Antigravity solo se alimentaba de capturas estáticas o lecturas de navegador generadas por su propio motor interno. Básicamente, si tu error ocurría probando un emulador de iOS o en una aplicación de escritorio nativa de Windows, el modelo estaba completamente a ciegas. Un auténtico dolor de cabeza para los desarrolladores multiplataforma.

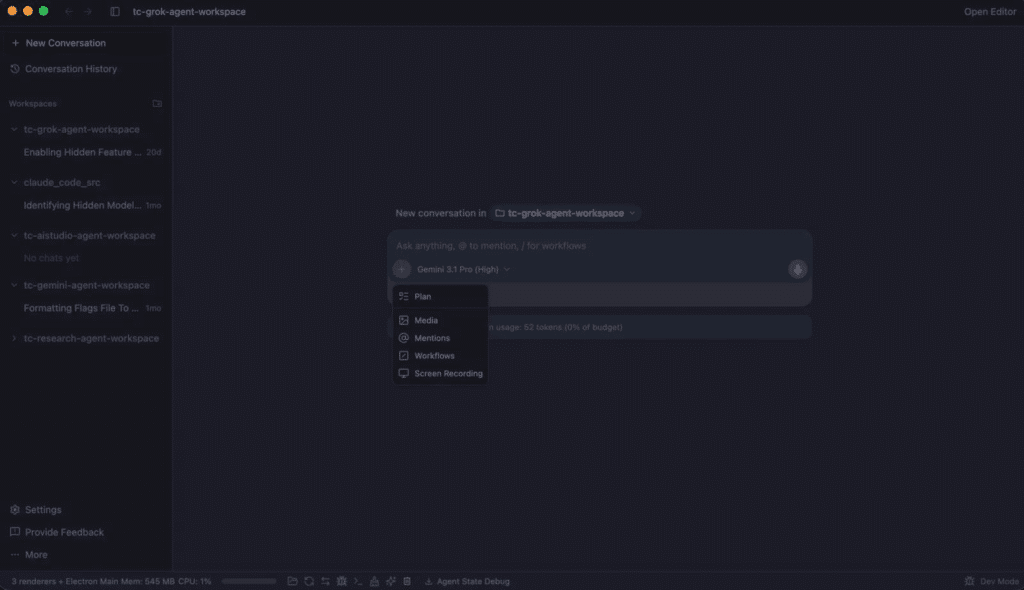

Pero claro, la historia acaba de dar un giro radical. La primera gran novedad filtrada es una opción de grabación de pantalla integrada directamente en el compositor de prompts del modo agente. Esta maravilla técnica permite al desarrollador transmitir su escritorio en tiempo real para que el LLM observe qué demonios ocurre fuera del código fuente. Así de simple. Es un movimiento técnico calcado a lo que ya vimos en AI Studio, donde Gemini ya traga vídeo en directo con una latencia bajísima.

También te puede interesar:Así es la Herramienta de Programación Antigravity en Google Gemini 3 ProEvidentemente, las posibilidades para el testing y la depuración de errores se disparan. Piensa en esas demostraciones en vivo donde necesitas mostrarle visualmente a la inteligencia artificial un bug rarísimo de la interfaz gráfica o un comportamiento errático de una animación. Ahora, simplemente compartes la pantalla, replicas el error en tu entorno externo y dejas que los modelos de visión de Gemini 3 analicen los frames. Todo el pipeline de trabajo gana una fluidez enorme.

Plugins y agentes a la carta: el guiño a Anthropic

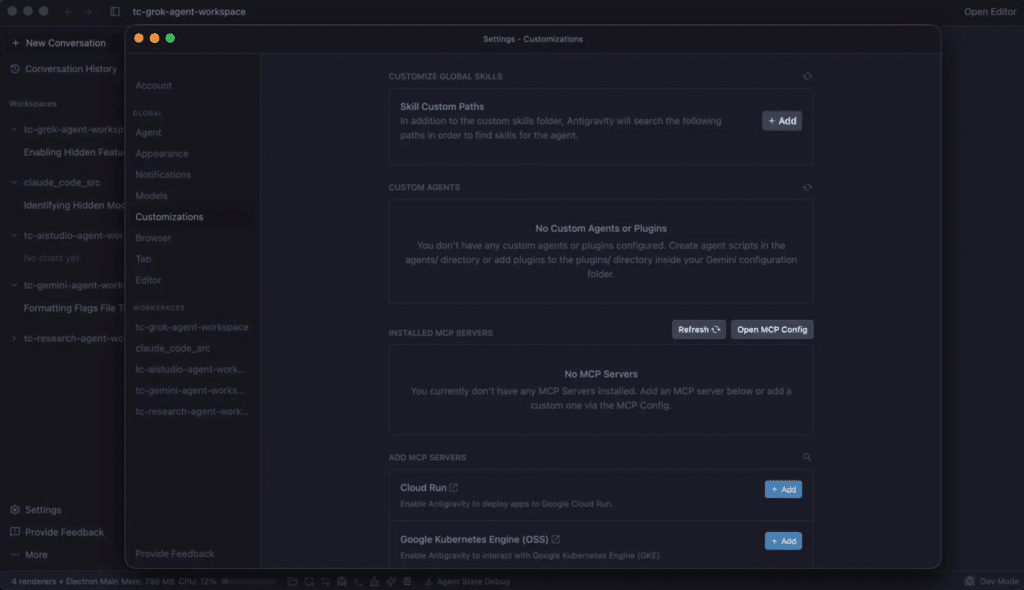

A ello se le suma el segundo gran bombazo que los ingenieros habían mantenido oculto bajo el capó. Buceando en los menús de configuración avanzada, ha aparecido una opción nativa para crear agentes personalizados y plugins. Y ojo con esto, porque es exactamente la pieza del rompecabezas que la comunidad llevaba exigiendo desde el minuto uno.

En concreto, el nuevo sistema permite a los usuarios soltar scripts de comportamiento en un directorio local de su ordenador. También habilita una carpeta dedicada dentro de la configuración general para instalar añadidos de terceros. Es decir, ahora puedes montar un escuadrón de asistentes en paralelo, cada uno con un prompt de sistema y unas herramientas conectadas específicamente para tareas como refactorización, auditoría de seguridad o revisión de bases de datos. Adiós a la rigidez.

Este cambio de rumbo tiene una explicación clarísima en los números de retención de usuarios. El formato inicial de Antigravity, basado en reglas de sistema demasiado cerradas, había recibido bastantes palos de la comunidad técnica. Muchos programadores vienen de ecosistemas ultraconfigurables como VS Code emparejado con Copilot, y el choque térmico al migrar a un entorno tan restrictivo era severo. Había que abrir el ecosistema o morir.

También te puede interesar:Así es la Herramienta de Programación Antigravity en Google Gemini 3 ProY es que aquí viene la jugada maestra para ganarse a los desarrolladores: el estándar elegido. En lugar de inventarse un formato privativo desde cero, Google ha basado la arquitectura de sus plugins en gran medida en el estándar de Claude Code de Anthropic. Una decisión brillante.

Por si fuera poco, esta compatibilidad arquitectónica abre la puerta a una interoperabilidad masiva entre ecosistemas rivales. Si una start-up crea una herramienta genial para Claude, apenas tendrá fricción técnica para portarla a Antigravity. De un plumazo, Google se asegura de que su IDE absorba el talento y las extensiones creadas por la competencia. Un movimiento de ajedrez impecable en plena guerra por la IA generativa.

Aunque Antigravity se vendió como la revolución de los agentes autónomos trabajando en paralelo, la realidad inicial fue algo más descafeinada. Le faltaba modularidad y, sobre todo, ojos para analizar el sistema operativo del usuario. Con esta inminente actualización, de la que aún no hay fecha de despliegue oficial pero que ya opera en fase experimental, Google tapa sus dos mayores vías de agua.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.