¿Cuántas veces has buscado algo en Google y has acabado añadiendo la palabra «Reddit» al final de tu consulta? Todos lo hacemos. Queremos leer a personas reales, no a marcas corporativas con textos eternos y vacíos. El gigante tecnológico es muy consciente de este patrón y ahora actualiza el modelo de búsqueda para inyectar directamente las entrañas de los foros públicos y blogs en sus resultados potenciados por Inteligencia Artificial.

La idea sobre el papel suena espectacular. Quieren que sus cajas de respuestas generativas dejen de ser un muro de texto aséptico y empiecen a incluir fragmentos de discusiones reales. A ello se le suma una nueva función que destacará activamente los enlaces que provengan de los medios de comunicación o plataformas a los que ya estés suscrito. Una personalización extrema orientada a retener tu atención.

Pero claro, mezclar la capacidad de un modelo de lenguaje con las profundidades de internet es jugar a la ruleta rusa. Los foros están llenos de debates técnicos que te pueden salvar el día si tienes un fallo raro en el ordenador, pero también son un nido de sarcasmo, trolls y caos absoluto. Procesar este texto no estructurado en tiempo real mediante técnicas complejas de IA tiene un riesgo evidente. Un cóctel explosivo.

La IA sigue tropezando con el sarcasmo humano

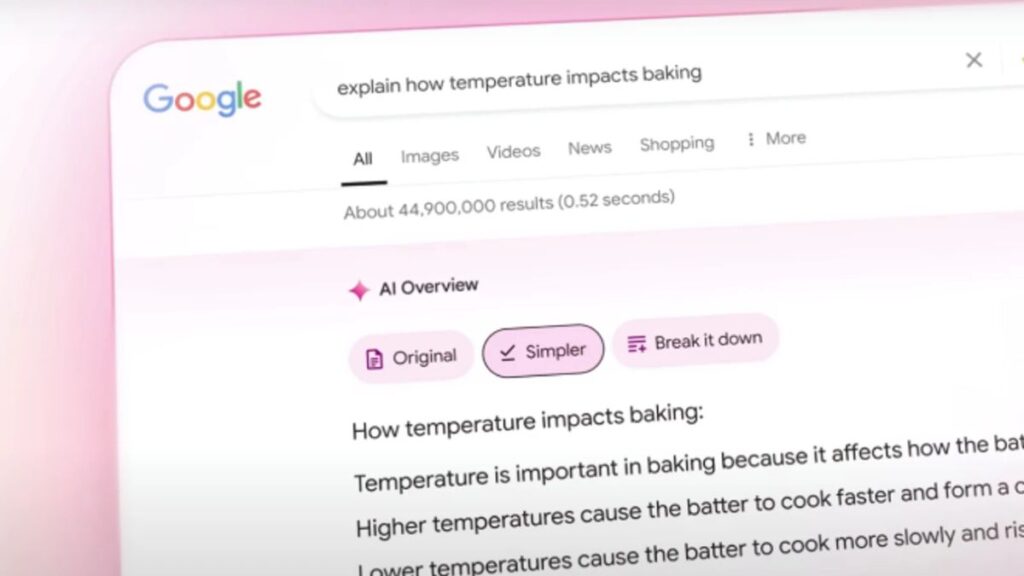

Si echamos la vista atrás, hace unos dos años que Google dio un volantazo drástico para meter su IA con calzador mediante los famosos AI Overview. Desde ese mismo instante, la recepción ha sido una auténtica montaña rusa. El núcleo del problema es que la máquina no detecta el contexto irónico de ciertas fuentes.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidos

Y es que hemos visto fallos que rozan lo surrealista en redes sociales. Quizás recuerdes la polémica cuando la IA recomendó comerse una piedra diaria al no saber interpretar un artículo de The Onion, un popular portal satírico. O la indignación generalizada cuando la pantalla sugirió a un usuario poner pegamento en la pizza para que el queso no se cayera, basándose ciegamente en una broma de Reddit de hace una década. Te ríes por no llorar.

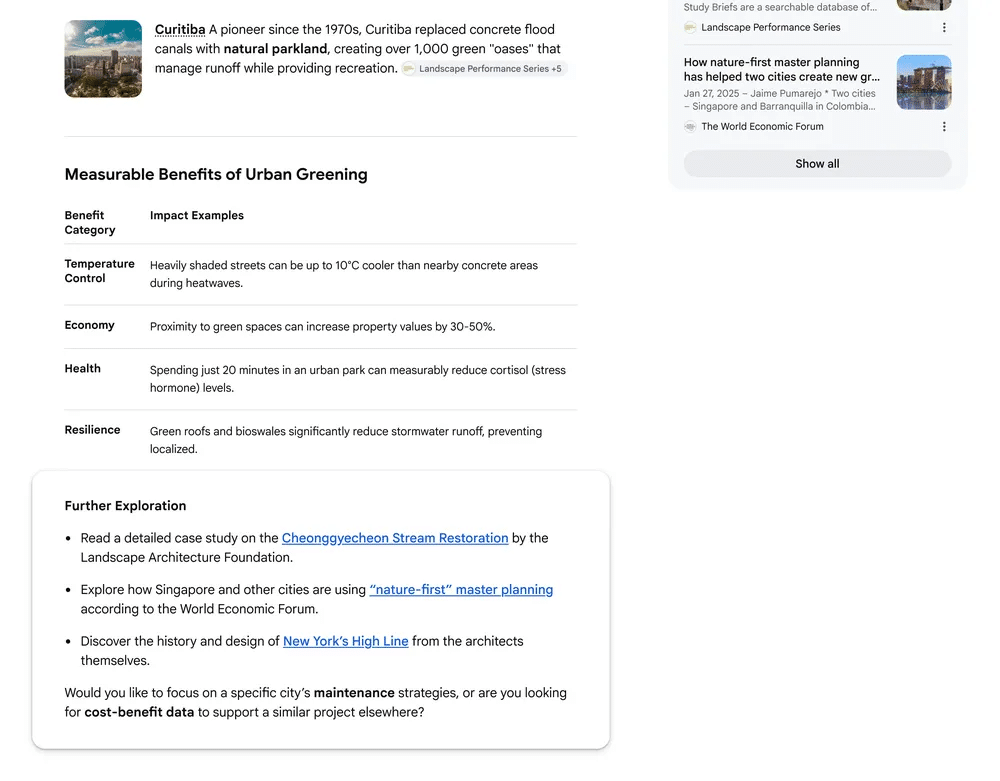

Si miramos los datos fríos, la mejora técnica es real, pero asusta por su escala masiva. Un reciente análisis del New York Times dejó claro que estas cajas de respuesta automáticas aciertan en unos 9 de cada 10 casos. Un 90% de precisión en cualquier otro software es un sobresaliente, pero en un buscador global, es una catástrofe en potencia.

El motivo es puramente matemático. Con el brutal volumen de consultas que los servidores procesan cada milisegundo, ese modesto 10% de margen de error significa que la infraestructura está escupiendo cientos de miles de resultados inexactos cada minuto. Una auténtica locura a nivel de desinformación global que no se soluciona metiendo más hardware.

¿Agregador de enlaces o un oráculo que todo lo sabe?

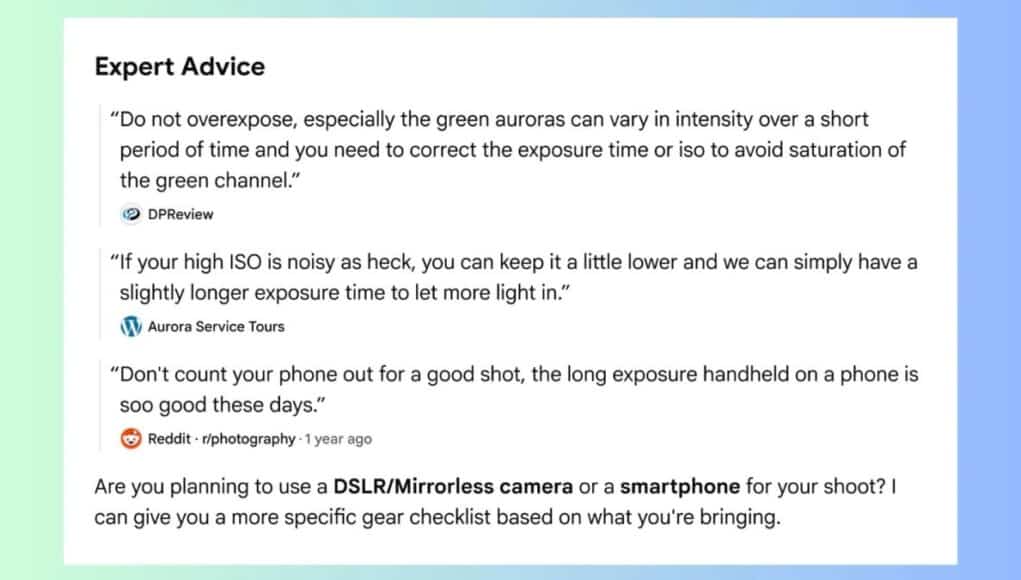

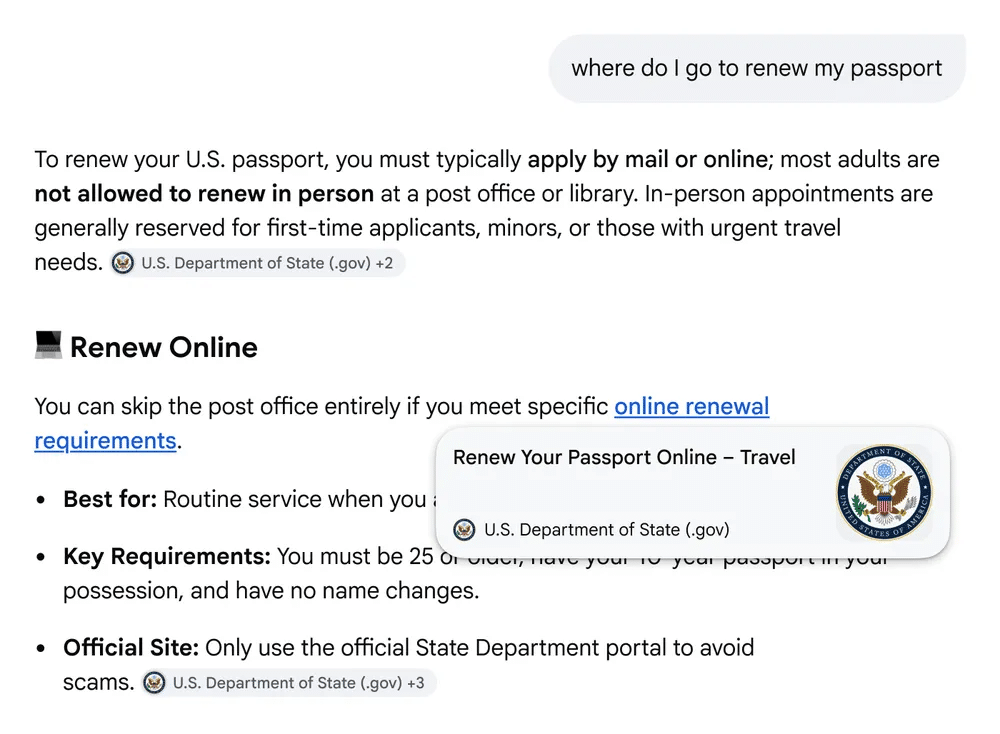

Para intentar parchear esta crisis de confianza, la empresa californiana explica que van a forzar un rediseño visual para aportar transparencia. Ahora, la IA mostrará el nombre del creador del contenido y la comunidad concreta de donde extrae la cita. Básicamente, te están dando las herramientas para que tú mismo decidas si esa fuente es fiable o es simple basura digital.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidos

Evidentemente, este enfoque nos lleva a plantearnos una contradicción técnica. Si la IA de Google tiene que acabar delegando en enlaces, citando foros y exigiendo al usuario que audite la fuente, ¿qué sentido tiene usar un LLM pesado para esto? La línea que separa a esta innovación de ser un oráculo que da respuestas directas o un simple agregador de enlaces caro está cada vez más borrosa.

Por si fuera poco, este movimiento huele a un intento acelerado por alcanzar la tracción de herramientas como ChatGPT o Claude. Esos sistemas de la competencia ya emplean técnicas de navegación en vivo para respaldar sus respuestas y calmar los nervios de los inversores ante el fantasma de las alucinaciones. Copiar lo que funciona es ley de vida en Silicon Valley.

Al final del día, la pelota sigue estando en el tejado de quien teclea. Por muchos paneles de contexto y metadatos que añadan a la interfaz, los modelos generativos se van a seguir inventando hechos cuando su base de datos flaquee. Toca asumir que la IA no es infalible y seguir leyendo con lupa antes de echarle pegamento industrial a la cena de esta noche.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.