Generar texto con inteligencia artificial en tu propio ordenador siempre ha tenido un gran enemigo silencioso: la lentitud insoportable. Y no por falta de potencia bruta en los chips, sino porque el ancho de banda de la memoria frena constantemente el flujo de datos. Pero parece que Google acaba de encontrar una vía de escape brillante. Acaban de anunciar que sus nuevos modelos Gemma 4 integran una técnica brutal llamada speculative decoding. La promesa es técnica, pero sus efectos son demoledores: acelerar drásticamente los tiempos de inferencia sin sacrificar ni un milímetro de precisión en la respuesta final.

Para entender el contexto, hay que saber que la inferencia en los LLM funciona leyendo pesados bloques de memoria para escupir una sola palabra cada vez. Es un proceso tedioso y aburrido. Básicamente, esta innovación cambia por completo las reglas del juego para quienes desarrollan en local o en dispositivos con recursos limitados. Si alguna vez has intentado correr un modelo pesado en tu máquina, sabes que a veces va a pedales y la latencia te saca de quicio. Ahora, Google apunta directamente a volar por los aires este embudo de procesamiento.

El truco del «speculative decoding» o cómo predecir el futuro

Si miramos bajo el capó de este anuncio, la magia que sustenta esta nueva arquitectura para desarrolladores es puro ingenio de ingeniería. En lugar de procesar palabra por palabra de forma estrictamente lineal, la técnica pone a dos modelos diferentes a trabajar en equipo. Tenemos el modelo principal, que es gigantesco y muy capaz, emparejado con un asistente más pequeño y ligero conocido como modelo «drafter» o MTP (Multi-Token Prediction). Una auténtica proeza técnica.

El sistema funciona de manera similar a un directivo brillante dictando a un secretario que teclea a velocidad de vértigo. El modelo ligero, el drafter, se adelanta y genera varios tokens futuros de golpe, intentando adivinar el camino lógico que tomará la frase. Simultáneamente, el modelo principal de alta capacidad se dedica en exclusiva a verificar esas predicciones en paralelo. Si el secretario acierta, el jefe aprueba todo el bloque de texto del tirón y se publica la respuesta.

Aterrizando la idea técnica en resultados palpables: el sistema puede aceptar y mostrar una secuencia completa en el mismo tiempo que antes tardaba en calcular un triste token. El salto abismal en velocidad es evidente. Y lo mejor es que el modelo grande no pierde el tiempo «escribiendo», solo revisa, valida y corrige si se detecta un fallo. Gracias a esta constante auditoría del hermano mayor, el sistema mantiene intacta su capacidad de razonamiento. Ni más alucinaciones, ni bajadas de calidad. Así de simple.

Gemma 4: la pesadilla de la latencia en dispositivos edge

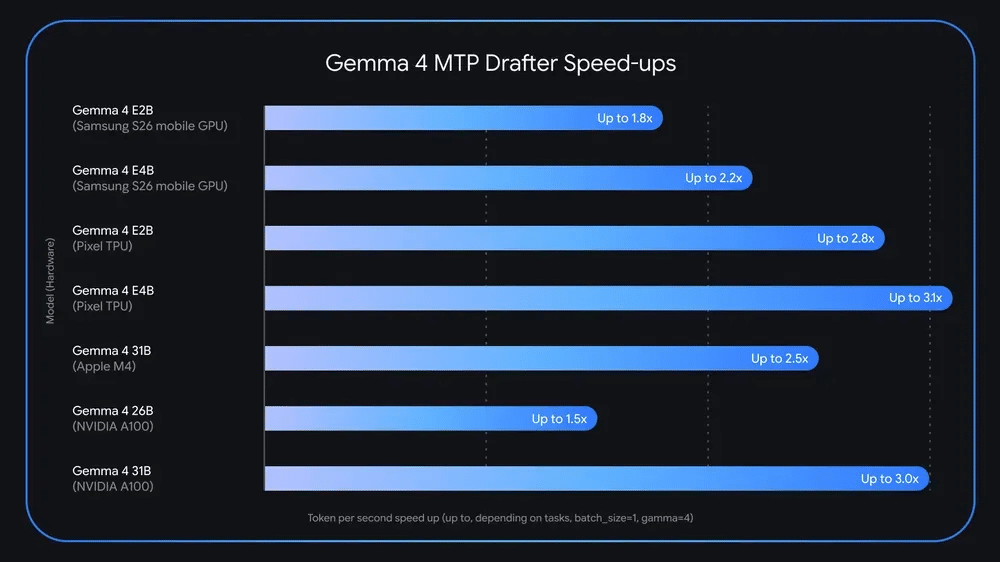

Lo verdaderamente disruptivo de este movimiento es exactamente dónde ha decidido Google aplicar semejante mejora. No han reservado esta joya de optimización para sus servidores premium en la nube. La han implementado de fábrica en la familia Gemma 4, abarcando tanto la eficiente variante 26B MoE (Mixture of Experts) como el mastodonte 31B Dense. Estamos hablando de modelos con miles de millones de parámetros corriendo de forma fluida donde antes era impensable.

Y aquí viene el dato clave que está celebrando toda la comunidad open-source con entusiasmo. Toda esta arquitectura está afinada para funcionar sin problemas en GPUs de consumo y dispositivos edge. Hablamos de tarjetas gráficas de un ordenador de sobremesa o teléfonos móviles trabajando de forma totalmente aislada. Los desarrolladores ya están reportando mejoras salvajes en la velocidad de desarrollo local. Han roto una barrera tecnológica formidable.

Por pura lógica, el impacto más inmediato lo notaremos en las aplicaciones de nueva generación que usamos cada día. Imaginemos chatbots locales hiperrápidos, asistentes de programación integrados en tu editor de código que no te cortan el ritmo, o agentes autónomos operando en tu smartphone. Todas estas herramientas críticas necesitan una latencia ultrabaja para ofrecer una experiencia digna. A nadie le gusta mirar un cursor parpadeando en blanco durante cinco larguísimos segundos.

Eficiencia frente a la tradicional fuerza bruta

Si prestamos atención a los primeros análisis técnicos de la comunidad, las opiniones coinciden de forma unánime. Las ganancias de velocidad en los despliegues en el edge y en aplicaciones en tiempo real son extraordinarias. Con esto, la compañía demuestra que ha entendido perfectamente que la próxima gran guerra de la inteligencia artificial ya no consiste solo en lanzar el modelo más grande. La optimización extrema es el nuevo estándar del mercado.

Hasta hace nada, paliar la falta de ancho de banda de memoria exigía comprar hardware especializado con costes absolutamente prohibitivos. Era una barrera de entrada letal para cualquier pequeña start-up o investigador independiente. Integrar el speculative decoding desde la base democratiza el acceso a inteligencias artificiales de muy alto nivel, eliminando fricciones económicas.

Tocará esperar para ver cuánto tarda la competencia en copiar el enfoque y estandarizar técnicas similares en sus propios ecosistemas abiertos. Es innegable que gigantes como Meta o Mistral estarán analizando con lupa el rendimiento de estos nuevos Gemma 4. De momento, la utopía de llevar un modelo avanzado de 31.000 millones de parámetros en la mochila y que genere texto al instante ya es una realidad palpable. La pelota está ahora en el tejado del resto de la industria.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.