Mark Zuckerberg ha decidido pisar el acelerador a fondo y dejarse de experimentos a medias en esta brutal guerra tecnológica. Si pensabas que la compañía se iba a conformar con tener un asistente de texto básico en tus redes sociales, estabas muy equivocado. Meta acaba de desplegar Muse Spark, su nuevo y rapidísimo modelo fundacional que ya impulsa toda la experiencia de Meta AI tanto en su aplicación nativa como en la web, y que promete cambiar nuestra forma de interactuar con el entorno.

Hablamos de un despliegue masivo, transversal y sin miramientos. Este nuevo «cerebro» digital se está integrando ahora mismo de forma simultánea en WhatsApp, Instagram, Facebook, Messenger, Threads y, por supuesto, en sus famosas gafas inteligentes. Ya no tienes que ir a buscar a la inteligencia artificial, porque ella te va a encontrar a ti en cada app que abras a diario. Una jugada maestra.

La cámara de tu móvil ahora procesa la realidad en tiempo real

Y es que el gran salto cualitativo de este modelo no reside solo en escribir textos más rápido, sino en tener ojos y oídos integrados de forma cien por cien nativa. Las nuevas funciones de IA en directo permiten que simplemente apuntes con la cámara de tu dispositivo a cualquier objeto, monumento o lugar, y el sistema te ofrezca contexto inmediato. Le pasas la cámara por encima y te explica lo que estás viendo. Así de simple.

En concreto, Muse Spark incorpora capacidades de codificación visual y percepción multimodal desde sus cimientos más profundos. No es un software parcheado intentando traducir torpemente una imagen a palabras. El modelo visualiza el mundo físico, lo procesa en milisegundos y te responde al momento, casi sin latencia perceptible para el ojo humano.

A ello se le suma una actualización radical en la forma en la que mantenemos conversaciones por voz con las máquinas. Ahora puedes hablar de manera totalmente natural, interrumpir al asistente a mitad de su respuesta, cambiar de tema bruscamente o incluso saltar a otro idioma sin que el flujo de la charla colapse. Tal y como detallan desde la fuente oficial de Meta, el asistente te escucha activamente y se adapta al caos habitual de la voz humana.

Por si fuera poco, mientras le hablas, esta bestia tecnológica es capaz de escupirte imágenes generadas en tiempo real o lanzarte recomendaciones híper precisas en la pantalla. Una auténtica locura si nos paramos a pensar en la gigantesca cantidad de recursos de servidor que exige un proceso como este.

Comprar por internet ya no será lo mismo: entran los subagentes

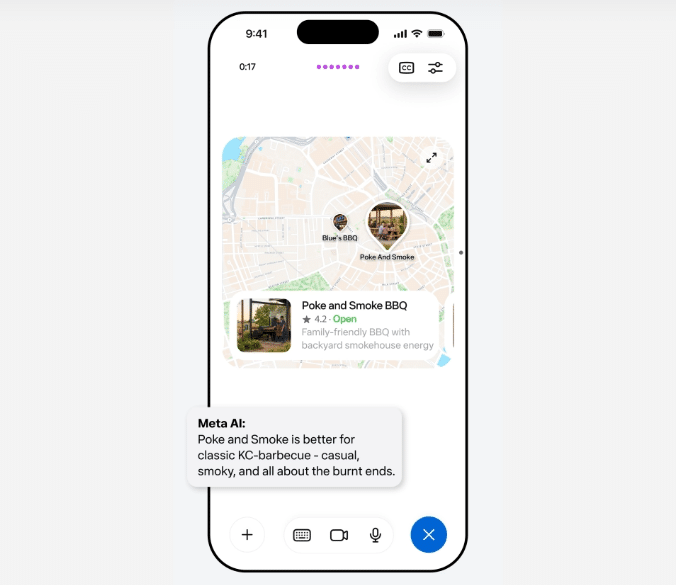

Pero claro, Meta sigue siendo una inmensa máquina de monetizar la atención y no iba a dejar fuera el lucrativo sector del comercio electrónico. Muse Spark estrena un modo de compras ultrainteligente que agrega de un plumazo los listados infinitos de Facebook Marketplace junto con productos de toda la web. Todo unificado bajo una misma interfaz visual para que no salgas de su ecosistema.

También te puede interesar:Meta Muse Spark, su Nueva IA Multimodal Que Razona para Competir contra ChatGPT, Claude y Gemini

Si miramos los números y la usabilidad, el sistema te planta delante una navegación basada en mapas interactivos, con filtros de precio y estilo extremadamente granulares. Además, te da acceso directo al catálogo de las grandes marcas presentándotelo en un cómodo formato de cuadrícula. Ya no vas a tener que abrir veinte pestañas en el navegador del móvil para comparar unas zapatillas o un mueble de segunda mano.

Básicamente, lo que han logrado los ingenieros de Meta Superintelligence Labs es reconstruir desde cero su infraestructura de IA para crear un sistema capaz de realizar multitarea avanzada. Y aquí entra la magia arquitectónica de los llamados subagentes, la verdadera clave de este lanzamiento.

Es decir, en lugar de usar un único y pesadísimo modelo monolítico para todo, Muse Spark delega tareas específicas a mini modelos especializados que trabajan en paralelo. Mientras un subagente rastrea precios, otro analiza tu tono de voz y un tercero interpreta lo que ve tu cámara. Esto lo hace ridículamente compacto, eficiente y capaz de comprender el contexto del mundo real mucho mejor que sus rivales directos.

Un modelo compacto enfocado en la superinteligencia personal

Evidentemente, orquestar todo esto requiere una precisión matemática absoluta. A pesar de ser un modelo de tamaño reducido, Muse Spark llega entrenado con una sorprendente capacidad de razonamiento avanzado. Domina áreas complejas como la ciencia, las matemáticas puras y la salud, un hito que los grandes expertos del sector ya catalogan como un avance gigantesco hacia los verdaderos asistentes personales.

El objetivo declarado desde las oficinas de Menlo Park es empujar los límites de la industria hacia lo que ellos mismos denominan «superinteligencia personal». Prometen, eso sí, que toda esta invasión sensorial en nuestro día a día vendrá escudada por estrictas medidas de seguridad corporativa y filtros de privacidad. Veremos en qué queda eso cuando auditen sus prácticas con lupa.

La letra pequeña es que, como era de esperar con este tipo de despliegues tan agresivos en infraestructura, por ahora solo los usuarios de Estados Unidos y Canadá pueden probar Muse Spark. Es el peaje habitual de la tecnología punta.

La expansión geográfica será progresiva y llegará muy pronto a las populares gafas Ray-Ban Meta y a las futuras Oakley Meta, abriendo un nuevo universo de hardware ponible. Tocará armarse de paciencia para probarlo en nuestros móviles europeos, pero el tremendo golpe sobre la mesa ya resuena en toda la industria. La pelota está ahora en el tejado de OpenAI y Google para demostrar si pueden seguir este ritmo infernal de innovación gratuita.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.