La carrera por tener el modelo fundacional más listo del mercado está muy bien de cara a la galería, pero en el mundo real de las empresas, lo que manda es la velocidad de respuesta y la factura a final de mes. Tras meses de especulaciones sobre cómo iban a optimizar sus infraestructuras, Google acaba de dar un golpe sobre la mesa lanzando oficialmente Gemini 3.1 Flash-Lite. Hablamos de una nueva bestia dentro de la familia Gemini 3 que ya está disponible de forma general para desarrolladores y clientes a través de Google Cloud.

Y el objetivo de este lanzamiento es clarísimo. Si necesitas que la inteligencia artificial procese montañas de datos sin que el servidor te deje esperando en blanco, este es el modelo a seguir. Una auténtica locura.

El rey de la baja latencia y los costes reducidos

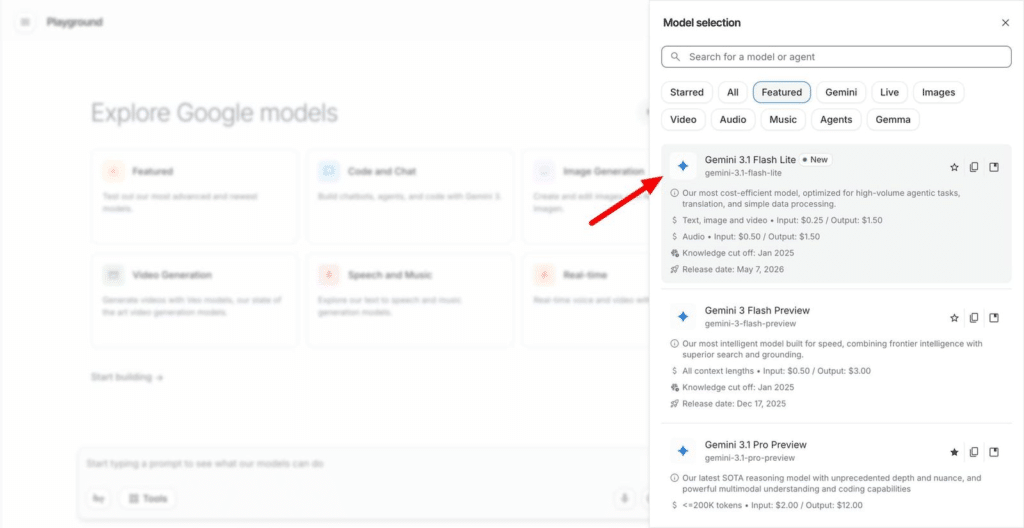

Si miramos los números fríos, la propuesta de los de Mountain View asusta bastante a la competencia directa. Se ha posicionado desde el minuto uno como el modelo más rápido y rentable de toda la serie Gemini 3. Evidentemente, esto no está pensado para escribir novelas filosóficas o generar código complejísimo desde cero, sino para entornos corporativos donde el volumen de peticiones es masivo y repetitivo.

En concreto, este modelo ofrece tiempos de respuesta inferiores a un segundo cuando le pides tareas de clasificación de datos. Y eso cambia las reglas del juego por completo. Imagina un gigantesco centro de atención al cliente ordenando decenas de miles de correos y quejas por nivel de urgencia en tiempo real. Ni se inmuta.

También te puede interesar:Google Presenta Gemini 3.1 Flash-Lite, Su IA Más Rápida y BarataPero la métrica técnica que de verdad está dando que hablar entre los ingenieros de software es otra. Gemini 3.1 Flash-Lite mantiene una latencia p95 de aproximadamente 1,8 segundos para la generación completa de respuestas. Básicamente, significa que el 95% de las veces vas a tener el texto o la acción terminada en tu pantalla en menos de dos segundos, incluso cuando los servidores de Google están sufriendo picos de carga concurrentes salvajes.

Más allá del texto: multimodalidad y automatización «agentica»

A ello se le suma que Flash-Lite no se queda estancado en procesar simples cadenas de palabras. El modelo incorpora poderosas capacidades multimodales nativas, lo que le permite tragar, analizar y razonar cruzando texto e imágenes de manera simultánea. Es decir, puedes pasarle un extenso manual de instrucciones en PDF junto a la foto de un error en tu ordenador, y te cruza los datos al instante para darte la solución.

Por si fuera poco, los primeros usuarios que han tenido acceso están destacando por encima de todo su habilidad para ejecutar tareas agenticas robustas. Quizás este nombre no te suene de nada, pero en el sector tecnológico es la obsesión del año. Significa que la IA no se limita a responderte un texto, sino que actúa y toma decisiones. Puede hacer llamadas a herramientas externas, extraer datos de APIs de la empresa y orquestar flujos de trabajo enteros por su cuenta. Le das el objetivo y él ejecuta los pasos de forma invisible. Así de simple.

La letra pequeña histórica de este tipo de modelos de alto rendimiento es que mantener una velocidad extrema siempre acaba destrozando la calidad del razonamiento. Sin embargo, parece que Google ha conseguido romper ese techo de cristal. Han mejorado de forma drástica el equilibrio entre velocidad, coste computacional y rendimiento cognitivo si lo comparamos con las versiones anteriores de su propio pipeline de la gama Flash.

Un ecosistema empresarial que ya lo está exprimiendo a gran escala

De hecho, esto no vende humo ni es una simple promesa a futuro en un gráfico para inversores. Empresas punteras del mercado ya han migrado sus sistemas para usarlo en producción masiva. Hablamos de gigantes del desarrollo como JetBrains, la plataforma de soporte avanzado Gladly o la firma de servicios financieros Ramp. Todas ellas lo utilizan ahora mismo para automatizar procesos pesados sin sacrificar un ápice de calidad en el servicio al cliente.

Como era lógico suponer, los sectores que más jugo le van a sacar a esta herramienta están extremadamente definidos. Google apunta directamente a la ingeniería de software, la atención al cliente, las industrias creativas y las finanzas. Estos nichos necesitan exactamente esto: operaciones de alto volumen con resoluciones instantáneas. Puedes revisar a fondo todos los entresijos técnicos y benchmarks oficiales en la fuente del anuncio de Google.

En el fondo, este lanzamiento refleja a la perfección el enfoque estratégico actual de Sundar Pichai y su equipo directivo. Se han dado cuenta de que tener el LLM más brillante y gigantesco del mundo no sirve para dominar el mercado corporativo si las empresas no pueden asumir la millonaria factura de la inferencia. Su jugada maestra es liderar los despliegues empresariales ofreciendo una fiabilidad extrema a un precio de derribo.

Tocará esperar para ver si firmas como OpenAI o Anthropic deciden responder entrando en una guerra de precios y latencias ultrabajas a lo largo de este año. De momento, la pelota está en el tejado de los programadores, que tienen una nueva máquina rapidísima y barata en sus manos. Y esto es solo un aviso de lo rápido que está mutando este sector.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.