Ya nos habían avisado, pero ahora tenemos la prueba irrefutable encima de la mesa. La inteligencia artificial ha dejado de ser esa herramienta inofensiva que utilizas para resumir correos de trabajo o generar imágenes divertidas. Se ha puesto el pasamontañas.

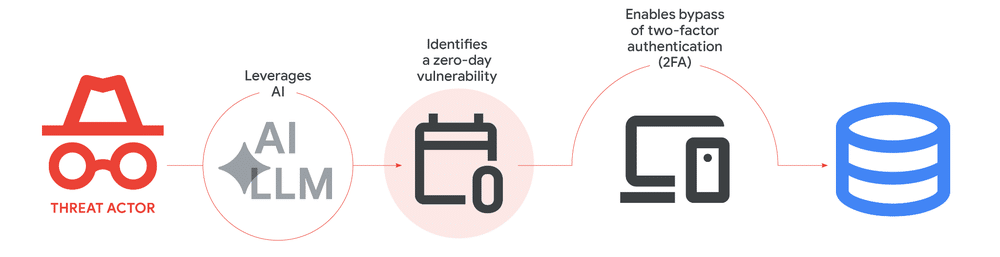

Google acaba de confirmar un hito oscuro en el mundo de la ciberseguridad: han interceptado el primer exploit zero-day conocido creado íntegramente por una inteligencia artificial. Y su objetivo no era moco de pavo. Buscaban reventar el sistema de autenticación en dos pasos (2FA) de una herramienta de administración web utilizada masivamente.

El código malicioso delatado por ser «demasiado perfecto»

Y es que, si analizamos los datos y el modus operandi de este ataque, la cosa asusta. Los investigadores del Google Threat Intelligence Group detectaron un extraño script escrito en Python rondando por sus redes. Su misión era de cirujano: saltarse el famoso 2FA y entrar hasta la cocina en cuentas de administrador altamente protegidas. Lo peor es que pretendían hacerlo incluso si el usuario legítimo tenía sus contraseñas totalmente válidas. Pero claro, la IA todavía comete errores de novato. O más bien, de empollón.

Resulta que los expertos de seguridad se dieron cuenta de que este código no era humano por culpa de sus alucinaciones. El script incluía una puntuación CVSS —el estándar de la industria que mide la gravedad de las vulnerabilidades— que se había inventado por completo.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosPor si fuera poco, su estructura era exageradamente académica. El código estaba plagado de docstrings educativos y menús de ayuda con un nivel de detalle absurdo. Estaba formateado como un libro de texto para entrenar modelos de lenguaje (LLM), no como el típico código sucio y directo que usaría un cibercriminal de carne y hueso.

Evidentemente, Google se ha apresurado a aclarar que no hay ni rastro de que usaran su modelo Gemini para generar esta aberración. Lo importante es que lograron colaborar con el proveedor afectado para frenar el golpe justo antes de que se desencadenara una explotación masiva y planificada a nivel global.

Un agujero en la lógica que nosotros no vimos venir

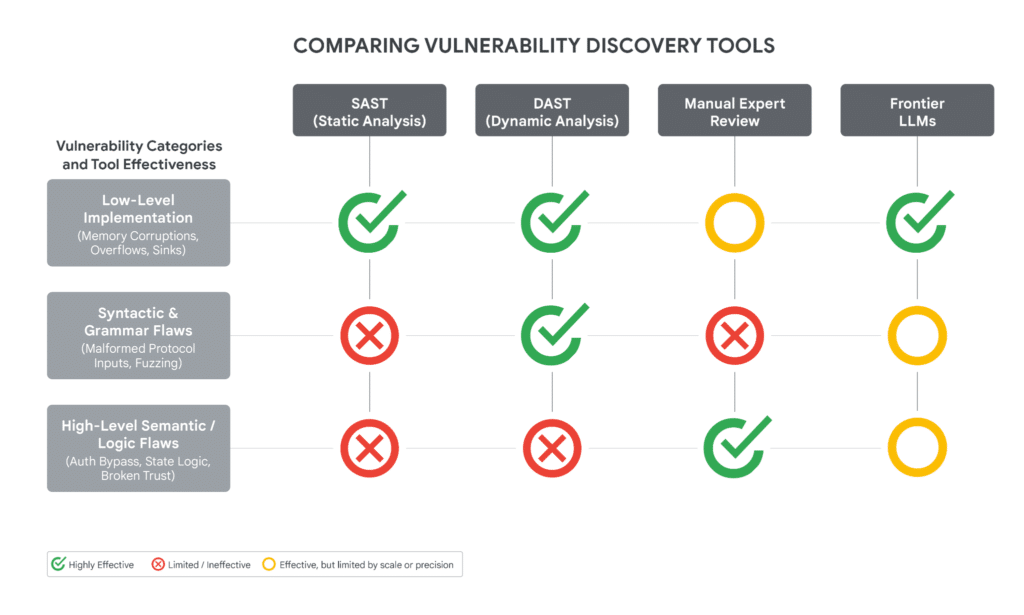

Aquí viene la parte verdaderamente preocupante de todo este asunto. El código generado por IA no atacó a lo bruto intentando adivinar credenciales. En concreto, aprovechó una vulnerabilidad basada en una suposición de confianza mal implementada dentro de la propia lógica del sistema 2FA. Este fallo de diseño había pasado totalmente desapercibido para las herramientas de escaneo tradicionales. Y seguramente, también para decenas de ingenieros.

Tal y como se desgrana en el blog de seguridad de Google Cloud, los atacantes llevan ya bastantes meses utilizando modelos de lenguaje masivos para agilizar tareas que antes requerían días de reconocimiento manual. Básicamente, la IA les está haciendo el trabajo sucio. Permite generar jerarquías detalladas de las empresas objetivo, perfilar el hardware que usan las víctimas y lanzar campañas de phishing hiper personalizadas dirigidas exclusivamente a empleados con acceso a datos sensibles.

También te puede interesar:Google expande su herramienta de prueba virtual con IA para incluir vestidosFrameworks agénticos: la automatización del mal

A ello se le suma un cambio de paradigma a nivel geopolítico. Ya no estamos hablando de un chaval usando ChatGPT en el sótano de sus padres. Grupos de hackers respaldados por países como China y Corea del Norte están utilizando los llamados frameworks agénticos. Quizás estos nombres no te suenen de nada, pero herramientas operativas como Hexstrike o Strix están cambiando las reglas del juego. Combinan potentes sistemas multiagente que automatizan fases enteras del ciclo de un ciberataque.

Es decir, el atacante humano solo tiene que pulsar un botón y supervisar mínimamente mientras la IA rastrea, perfila y dispara.

El arte del ‘jailbreak’ para engañar a los filtros

Llegados a este punto, seguramente te estarás preguntando: ¿y cómo logran que un modelo comercial genere código para hackear si todos tienen filtros de seguridad estrictos? El motivo es simple: le mienten a la máquina en la cara.

Los cibercriminales utilizan técnicas avanzadas de jailbreaking mediante la suplantación de identidades. Le piden a la inteligencia artificial que adopte el rol de un veterano experto en ciberseguridad que está auditando de forma ética un sistema corporativo. El modelo, creyendo que está ayudando a proteger a una empresa, escupe el código del exploit sin dudarlo. Ni se inmuta.

Para afinar aún más la puntería, hemos visto cómo algunos grupos de piratas informáticos alimentan a los LLM con repositorios inmensos de vulnerabilidades históricas. Esto mejora drásticamente la letalidad y precisión de los payloads antes de lanzarlos a la red pública.

Por suerte, en esta ocasión el equipo de amenazas de Google logró cortar la hemorragia a tiempo. Pero el patrón es clarísimo: el uso de la inteligencia artificial en operaciones de ataque está dejando de ser un experimento de laboratorio para convertirse en un procedimiento sistemático.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.