¿A quién se le escapa un modelo de IA de nueva generación semanas antes del evento más importante del año? A Google, claro. Tras meses de secretismo absoluto y rumores en los foros más recónditos de internet, los usuarios han hecho saltar todas las alarmas al cazar en vivo la interfaz de Gemini Omni, la nueva bestia de la compañía californiana enfocada a la generación y manipulación de vídeo. Una jugada que podría ser un despiste monumental o un agresivo movimiento de marketing encubierto.

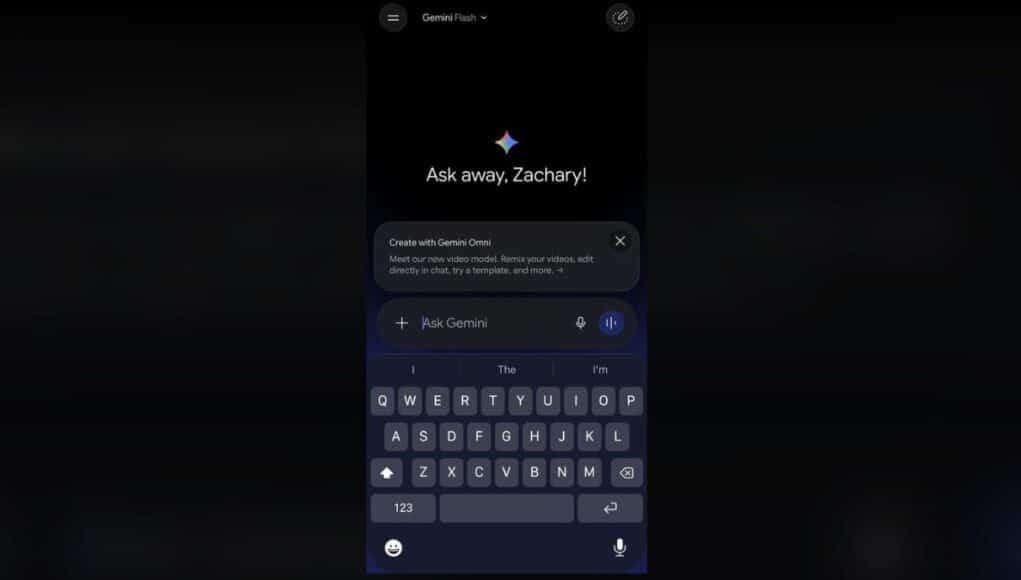

Y es que, si prestas atención a las capturas filtradas desde la comunidad, la situación no deja lugar a dudas. Vemos una flamante tarjeta de modelo en la interfaz web que promete crear vídeos desde cero, remezclar contenido ya existente y aplicar plantillas predefinidas. Todo esto embutido de forma nativa desde la misma caja de chat unificada que ya usas a diario para redactar correos o picar código en Python. Así de simple.

Evidentemente, el objetivo de la gran «G» es destruir por completo la fricción. Hasta ahora, si querías trastear con vídeo sintético tenías que saltar a plataformas externas, pelearte con servidores de Discord o usar interfaces bastante pesadas en el ordenador. Quieren que tu flujo de trabajo sea tan natural como mantener una conversación con un amigo, apostando a vida o muerte por la integración multimodal.

El verdadero poder de Gemini Omni no es crear, es editar

Si miramos los números y las primeras quejas de los testers accidentales, hay que ser muy claros. La calidad bruta de generación visual de Gemini Omni no te va a dejar con la boca abierta hoy por hoy. Como era de esperar, los usuarios reportan que se sitúa un par de escalones por debajo de titanes asiáticos como Seedance 2 de ByteDance, que sigue siendo el referente absoluto si buscas fotorrealismo o textura puramente cinematográfica.

Pero claro, la magia de esta nueva inteligencia artificial reside en una faceta muy distinta. Donde Omni rompe el mercado y saca pecho es en su abrumadora capacidad de edición mediante el prompting. Hablamos de tareas quirúrgicas que normalmente requerirían horas delante de un software profesional de posproducción. Imagina poder borrar marcas de agua molestas, sustituir un coche por una moto en medio de un clip en movimiento o alterar radicalmente la iluminación de una escena usando solo instrucciones en texto natural.

Este enfoque táctico te resultará extremadamente familiar si sigues de cerca la hoja de ruta de la compañía. Ya lo vivimos hace muy poco con el polémico despliegue de Nano Banana, el modelo de imagen nativo de la familia Gemini. Al principio, sus generaciones partiendo de un lienzo en blanco arrojaban resultados plásticos y mediocres. Sin embargo, demostró ser una máquina rápida e impecable a la hora de editar imágenes que ya existían, ganando tiempo de mercado hasta que las actualizaciones terminaron afinando el motor principal. Google repite la jugada paso por paso.

Los créditos vuelan y la oferta se fragmenta

A ello se le suma el siempre espinoso debate sobre los altísimos costes de inferencia en la nube. Mover píxeles dinámicos exige una potencia de cálculo brutal, y la filtración de Reddit ha dejado al descubierto una nueva pestaña de límites de uso en los ajustes de la cuenta. Básicamente, Google va a atar en corto a los usuarios implementando un estricto sistema de consumo por créditos para evitar que los servidores colapsen el primer día.

Y prepárate para vigilar la cartera, porque los afortunados que han podido exprimir esta beta de prueba aseguran que el modelo devora tu saldo a una velocidad de vértigo. Una auténtica locura. Esto nos confirma que la computación de vídeo sigue siendo el cuello de botella más caro y limitante en la carrera actual de la IA generativa.

En concreto, los rumores más fiables apuntan a que los de Mountain View van a trocear su tecnología para hacerla económicamente viable. Suena con muchísima fuerza que disfrutaremos de un lanzamiento escalonado con dos sabores clásicos: Flash y Pro. Es decir, tendremos una versión ligera y rápida para los memes del día a día, y un modelo ultravitaminado, pesado y premium para el sector profesional. Suponemos que estas muestras tempranas provienen del modelo Flash, lo que explicaría fácilmente esa falta de hiperrealismo en los detalles finos.

El banco de pruebas perfecto antes del Google I/O

La letra pequeña es que este supuesto agujero de seguridad llega en un momento sospechosamente conveniente para la narrativa corporativa. Faltan apenas unas semanas para el mítico Google I/O, programado oficialmente para el 19 y 20 de mayo. Es el gran escaparate global donde la empresa enseña los dientes frente a miles de desarrolladores y marca el ritmo del software mundial.

Por si fuera poco, filtrar de forma semicontrolada una versión en desarrollo permite al equipo tomarle el pulso a la calle sin arriesgarse a un abucheo en directo. Recopilar estas críticas orgánicas sobre la calidad visual o el sangrado excesivo de créditos les proporciona un margen de maniobra impagable. Tienen margen para ajustar su agresivo discurso de marketing o, sencillamente, bajar las expectativas antes de que Sundar Pichai se enfrente a la prensa en el escenario principal.

Queda en el aire comprobar si esta obsesión de Google por aglutinar todas las herramientas imaginables en un solo chat termina enamorando a un público cada vez más saturado de promesas. Lo único seguro es que la guerra fría por dominar el vídeo sintético acaba de subir de temperatura. La pelota está ahora en el tejado de OpenAI y sus competidores. Veremos si se quedan de brazos cruzados o si deciden reventarles la fiesta antes de que llegue mayo.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.