¿Alguna vez has discutido con un asistente de voz y has sentido que le hablabas a un contestador automático de los años noventa? Esa era de voces robóticas soltando un guion monótono tiene los días contados. Inworld AI acaba de dar un golpe en la mesa con el lanzamiento de Realtime TTS-2, un modelo de síntesis de voz construido desde cero que no se limita a leer texto, sino que te escucha, entiende el contexto y reacciona de forma puramente conversacional.

Y esto no es una simple actualización de software. El sector llevaba años arrastrando un problema base: la mayoría de modelos estaban diseñados para narrar audiolibros o leer noticias, no para interactuar. Al intentar usarlos para charlar en vivo, el resultado era siempre torpe y carente de vida.

No es lo mismo leer un texto que mantener una charla de bar

La verdadera magia de este nuevo sistema reside en su capacidad de análisis previo. TTS-2 procesa el contexto completo del audio en intercambios de varios turnos antes de abrir siquiera la boca. No se queda únicamente con la transcripción de las palabras.

El motivo es muy simple: la IA necesita saber cómo suenas tú para responder adecuadamente. Si le hablas gritando, si estás bromeando o si acabas de dar una mala noticia, el modelo adapta su salida a ese ambiente concreto. Modifica por completo la interpretación de una misma frase dependiendo del tono de la conversación. Así de contundente.

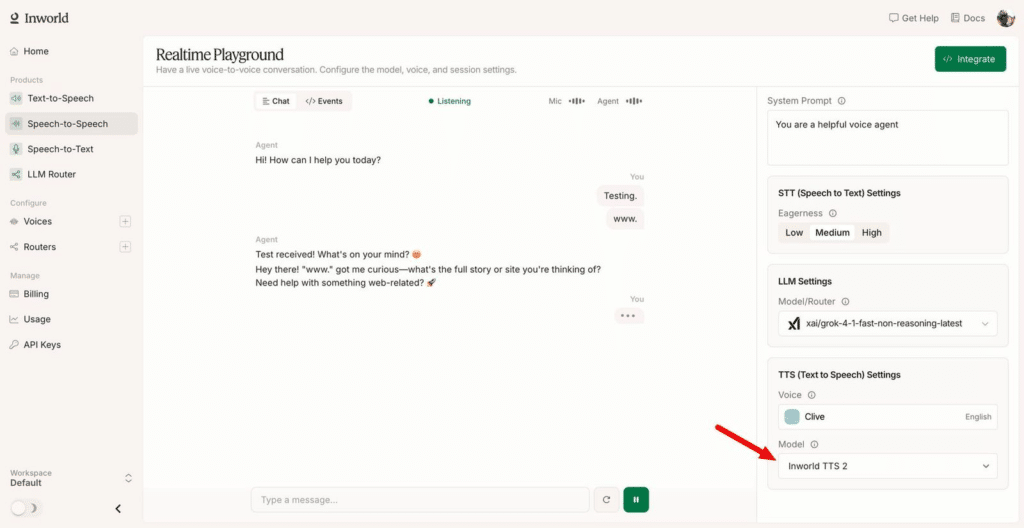

A nivel de desarrollo, han implementado algo que los creadores pedían a gritos. Se acabó depender de etiquetas rígidas predefinidas como «[feliz]» o «[triste]». Ahora puedes dirigir a la IA usando lenguaje natural, exactamente igual que si estuvieras dando indicaciones a un actor de doblaje real.

Es decir, puedes pedirle al modelo que suelte una pequeña carcajada, un suspiro de cansancio o un susurro justo después de una palabra concreta gracias a sus controles en línea. Esto aporta un nivel de expresividad que hasta hace muy poco parecía ciencia ficción.

Menos de 200 milisegundos: el límite para engañar al cerebro

Si analizamos los datos duros, la métrica que realmente importa en este sector es la latencia. Inworld AI ha logrado bajar de los 200 milisegundos de tiempo de espera hasta el primer audio generado. Una reacción casi inmediata.

Evidentemente, este umbral no es una cifra al azar. Es el tiempo exacto que nuestro cerebro necesita para percibir que un intercambio de palabras es natural y fluido, evitando esos incómodos silencios que delatan a un agente virtual. Si quieres lanzar un asistente de atención al cliente a gran escala, necesitas esta velocidad sí o sí.

Por si fuera poco, el sistema domina más de 100 idiomas con una fluidez asombrosa. Y aquí viene la parte interesante: puedes pedirle a la IA que cambie de español a japonés y luego a inglés en tiempo real, dentro de la misma respuesta. El modelo ni se inmuta y mantiene intacta la identidad vocal del hablante sin sonar como tres personas distintas.

Un gigante respaldado por millones y talento de DeepMind

Quizás el nombre de Inworld te suene un poco menos que OpenAI, pero no son unos recién llegados que trabajan desde un garaje. La empresa fue fundada por investigadores de primer nivel que salieron directamente de Google y DeepMind. Y el mercado se lo ha premiado inyectando más de 125 millones de dólares a través de fondos gigantes como Kleiner Perkins, Founders Fund o Lightspeed Venture Partners.

De hecho, su tecnología ya está rodando en el mercado a niveles que asustan. Aplicaciones como Wishroll consiguieron 1 millón de usuarios en solo 19 días usando sus modelos. Talkpal ya supera los 5 millones de estudiantes de idiomas y la plataforma Death by AI cuenta con 20 millones de jugadores. Las cifras dan verdadero vértigo.

Para que te hagas una idea de la magnitud del avance, la generación anterior de este TTS ya ocupaba tres de los cinco primeros puestos en el exigente ranking Artificial Analysis Speech Arena. Y sí, eso implica haber superado sin despeinarse a las mismísimas soluciones de Google y ElevenLabs. Casi nada.

Esta nueva herramienta ya está disponible a través de su API y cuenta con integraciones activas en plataformas como LiveKit, Pipecat o Vapi. Con este movimiento, Inworld demuestra que la voz interactiva exige arquitecturas entrenadas exclusivamente para conversar. Tocará ver si el resto de la industria toma nota rápidamente o se quedan atrás leyendo guiones prefabricados.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.