La burbuja de los datos de entrenamiento gratuitos está a punto de estallar en la cara de los gigantes de la IA. Y no lo digo yo, lo dicen directamente los juzgados estadounidenses. Tras meses de tensión acumulada entre editores y grandes tecnológicas, Encyclopedia Britannica y la icónica editorial del diccionario Merriam-Webster acaban de lanzar un misil legal directo a la línea de flotación de OpenAI.

El motivo es simple: acusan a la compañía liderada por Sam Altman de exprimir todo su catálogo protegido para entrenar a sus modelos sin pagar un solo céntimo de licencia. Una maniobra que lleva meses bajo la lupa judicial.

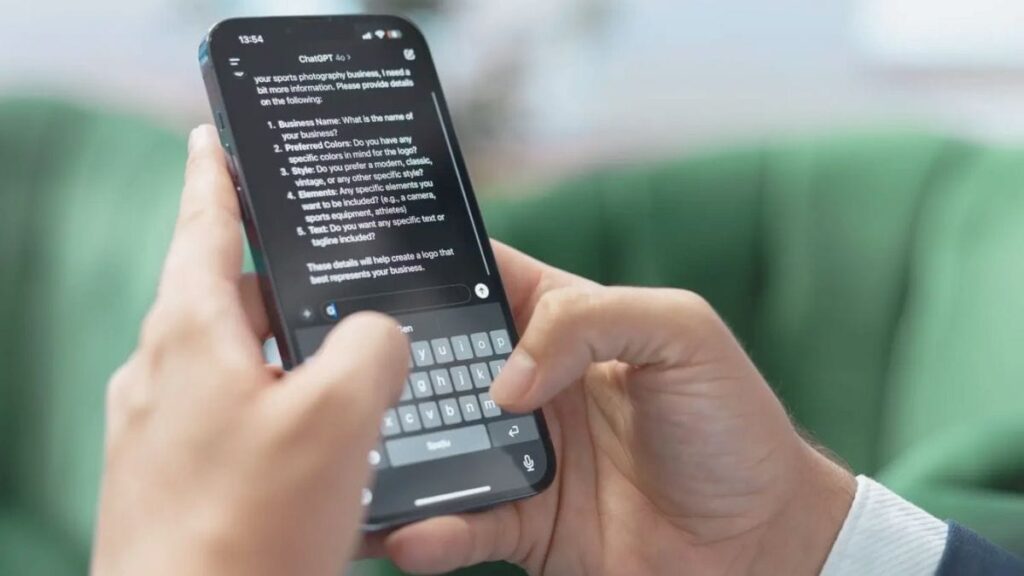

Pero la historia no se queda en una mera sospecha técnica. Los demandantes han puesto sobre la mesa pruebas documentales donde se ve cómo GPT-4 escupe textos prácticamente idénticos a los de sus páginas web originales. Una auténtica locura.

El problema de la «memorización» en el cerebro de los LLMs

Si miramos los detalles de la denuncia formal presentada ante los tribunales, la acusación principal gira en torno a un concepto técnico que es el talón de Aquiles de cualquier desarrollador. Hablamos de la sobre-memorización de los datos.

También te puede interesar:OpenAI Prioriza GPT-5.4 y Codex en su Ofensiva para Dominar el Sector EmpresarialBásicamente, los abogados de Britannica afirman que el modelo ha ingerido tal cantidad de sus artículos durante su fase inicial que los ha retenido directamente en su base de pesos. Y claro, cuando le haces el prompt adecuado en la interfaz de ChatGPT, la IA no razona la respuesta, sino que vomita el texto original casi palabra por palabra.

Evidentemente, esto choca de frente con el discurso oficial que mantienen las empresas de IA, donde defienden que sus redes neuronales «aprenden conceptos» de forma abstracta y no funcionan como una fotocopiadora. El texto legal incluye comparaciones directas y pantallazos entre las respuestas generadas por los modelos de OpenAI y los archivos de la enciclopedia. Las similitudes saltan a la vista.

Así de crudo. Las copias no autorizadas se habrían producido de forma sistemática y reiterada durante los kilométricos pipelines de entrenamiento de la compañía. Y eso huele a una posible infracción masiva de copyright.

Canibalización de tráfico: cuando el chatbot destroza tu modelo de negocio

Pero claro, el problema real detrás de todo este drama judicial no es solo el orgullo editorial por la autoría. Es la supervivencia del negocio a corto plazo. A diferencia de los motores de búsqueda tradicionales que todos conocemos, que te muestran un fragmento rápido y te redirigen obligatoriamente a la fuente original, ChatGPT funciona como un pozo cerrado. Según la información detallada por la agencia Reuters sobre el caso, OpenAI está «canibalizando» de forma flagrante el tráfico web legítimo de la editorial.

También te puede interesar:OpenAI Prioriza GPT-5.4 y Codex en su Ofensiva para Dominar el Sector Empresarial

Es decir, si buscas información sobre un evento histórico complejo y el chatbot te lo da perfectamente redactado y masticado usando los datos robados de Britannica, tú ya no haces clic en ninguna parte. No visitas su web. Sus banners de publicidad no generan impresiones. Todo el valor se lo queda el dueño del modelo.

A ello se le suma el hecho de que plataformas de consulta como Merriam-Webster dependen vitalmente del volumen diario de búsquedas rápidas. Si una interfaz de IA se interpone y responde de forma nativa, el impacto financiero para las arcas de la editorial es sencillamente devastador.

Un frente judicial que asusta a los inversores

Este no es, ni mucho menos, un caso aislado en la industria del software. La barra libre de «raspar» (scrapear) todo el contenido de internet sin pedir permiso está pasando una factura carísima a los pesos pesados del sector tecnológico.

Seguro que te suena la enorme batalla legal que aún mantiene The New York Times contra la propia OpenAI. Las acusaciones son prácticamente un calco: el uso intensivo, masivo y sin licencia de periodismo de calidad protegido por copyright para engordar los billones de parámetros de sus modelos fundacionales.

Por si fuera poco, los precedentes más recientes asustan, y mucho, al capital riesgo. Solo hay que recordar que, el pasado mes de septiembre, Anthropic tuvo que llegar a un acuerdo para resolver una gigantesca demanda colectiva por usar libros protegidos en sus entrenamientos. ¿El coste de aquel tropiezo? Un impresionante desembolso de 1.500 millones de dólares para compensar a los autores. Cifras mareantes.

Si a la empresa de Sam Altman le toca rascarse el bolsillo cada vez que un editor demuestra que ChatGPT ha memorizado uno de sus artículos, el desarrollo técnico podría enfrentarse a un muro financiero insalvable.

Tocará esperar para ver cómo se defiende el rey de la IA generativa ante estas pruebas tan gráficas y visuales. La típica táctica legal del «uso justo» o fair use empieza a hacer aguas cuando pones un bloque de texto de GPT-4 al lado de uno de Britannica y no eres capaz de encontrar diferencias. La pelota está ahora en el tejado de los tribunales estadounidenses. Veremos si toda esta presión fuerza de una vez un sistema de licencias justas, o si el sector sigue pisando el acelerador ignorando el retrovisor.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.