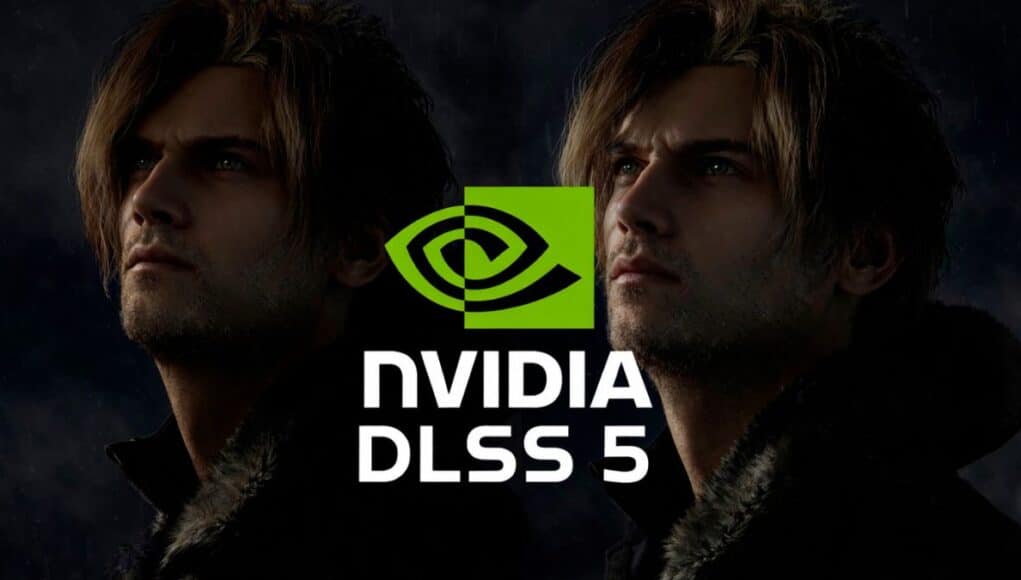

Durante el GTC 2026, NVIDIA presentó DLSS 5, la nueva generación de su sistema de supermuestreo con inteligencia artificial. El hallazgo no apunta solo a más cuadros por segundo. La compañía asegura que busca cambiar directamente la calidad visual de los juegos en tiempo real. Según la empresa, es su mayor avance en gráficos por ordenador desde el ray tracing (trazado de rayos, simulación realista de la luz) que debutó en 2018. Jensen Huang fue categórico al describirlo como un punto de inflexión, casi un “momento GPT” para los gráficos.

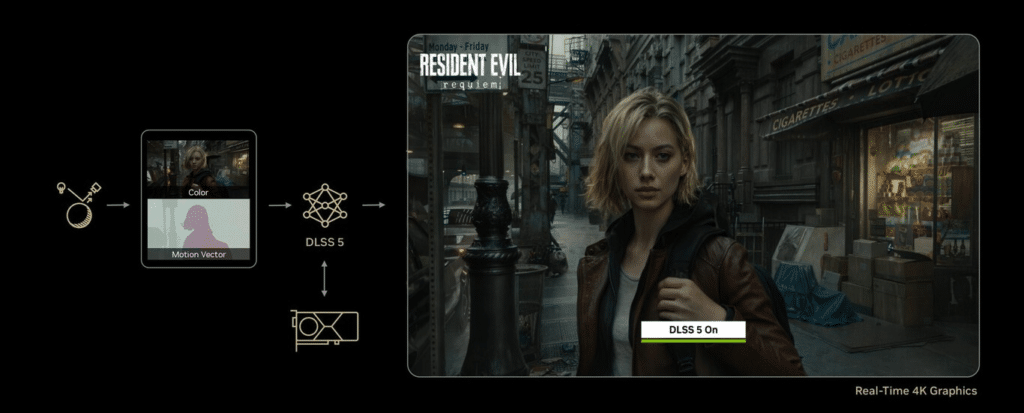

La pieza clave es un modelo de renderizado neuronal, una IA entrenada para reconstruir cómo debería verse una escena con iluminación y materiales más creíbles. El mecanismo analiza cada fotograma con datos de color y vectores de movimiento (dirección y velocidad de lo que cambia en pantalla).

Así, la IA detecta qué está mirando: piel, cabello, agua, tela o metal. Y a cada material le da un tratamiento específico. En la piel puede aplicar subsurface scattering (dispersión de la luz bajo la superficie), en las telas una iluminación más natural y en el metal reflejos menos rígidos.

Ese detalle importa porque el ojo humano nota enseguida cuando una escena pierde coherencia entre un fotograma y otro. NVIDIA sostiene que su sistema mantiene esa continuidad, algo central para que el realismo no se rompa al mover la cámara o cambiar de plano.

También te puede interesar:DLSS 5 Desata Polémica y NVIDIA Reacciona: “No es un Simple Filtro de IA…”Un motor extra para la imagen

La oportunidad que abre DLSS 5 está en combinar renderizado tradicional con IA generativa, una IA que crea o reconstruye contenido visual, sin quitar control creativo a los estudios. Es decir, el artista sigue diseñando la escena base y el modelo actúa como una capa de refinado.

Además, será compatible con rasterización (dibujado clásico de gráficos), ray tracing y path tracing (simulación aún más completa de la luz). Eso convierte a la tecnología en una especie de central flexible, capaz de enchufarse a varios métodos sin obligar a rehacer un juego desde cero.

En las demos ya se vio funcionando en títulos como Resident Evil Requiem, Hogwarts Legacy, Assassin’s Creed Shadows, Starfield y Oblivion Remastered. También se prevé su llegada a AION 2, Delta Force, Phantom Blade Zero, NARAKA: BLADEPOINT y Where Winds Meet.

Hay un dato técnico que ayuda a medir el desafío. En las demostraciones, NVIDIA usó dos GPU GeForce RTX 5090: una para ejecutar el juego y otra para el procesamiento de la IA. Pero la versión final, prevista para otoño de 2026, está diseñada para correr en una sola tarjeta de la serie GeForce RTX 50.

También te puede interesar:DLSS 5 Desata Polémica y NVIDIA Reacciona: “No es un Simple Filtro de IA…”Además, la compañía explicó que lleva unos tres años desarrollando este engranaje y que seguirá ajustándolo antes del lanzamiento. Cuanto mejor sea la iluminación base del juego, mejores resultados dará el modelo. No hace magia sobre una escena pobre. Potencia una base sólida.

Para el jugador común, la aplicación práctica es clara: mundos más creíbles sin esperar un salto de generación completo. Una capa de IA podría hacer que una cara se vea menos plástica, que una tela responda mejor a la luz o que el agua deje de parecer una simple textura brillante.

En Imagen 1, Imagen 2 y en la web oficial se observan comparativas que exponen ese salto. La promesa todavía debe probarse fuera del escenario controlado de una demo, pero el mensaje de NVIDIA ya es claro: no se trata solo de correr más rápido, sino de encender mejor cada habitación del mundo digital.

Directora de operaciones en GptZone. IT, especializada en inteligencia artificial. Me apasiona el desarrollo de soluciones tecnológicas y disfruto compartiendo mi conocimiento a través de contenido educativo. Desde GptZone, mi enfoque está en ayudar a empresas y profesionales a integrar la IA en sus procesos de forma accesible y práctica, siempre buscando simplificar lo complejo para que cualquiera pueda aprovechar el potencial de la tecnología.