Se acabó eso de mover cajitas y alinear píxeles a mano durante horas. Google acaba de soltar una bomba en el sector del diseño de interfaces, y los gigantes establecidos ya están sintiendo el temblor en sus cimientos. Google ha actualizado Stitch, transformándolo de una simple utilidad a un lienzo nativo de inteligencia artificial.

Promete hacer por la creación de interfaces lo que modelos como Claude Code hacen por la programación pura y dura. Y el mercado ha tomado nota rápido: las acciones de Figma se desplomaron poco después de este anuncio. Una auténtica locura.

Adiós al diseño tradicional, hola al «vibe design»

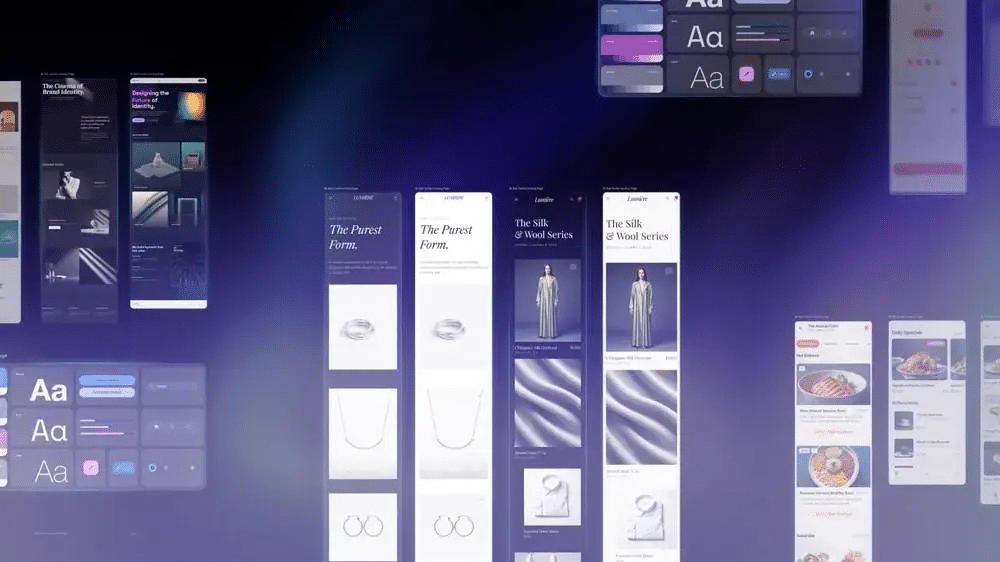

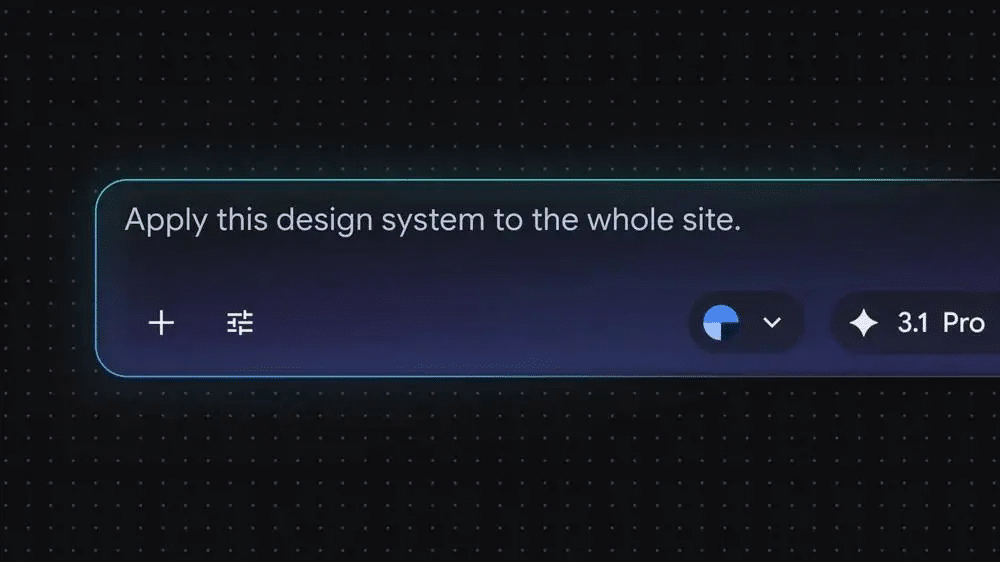

En concreto, lo que propone la firma de Mountain View es un cambio de paradigma total en nuestro flujo de trabajo. Ya no necesitas dominar complejas herramientas vectoriales o pasar días creando wireframes desde cero. La nueva versión de Stitch permite crear prototipos completamente funcionales simplemente describiéndolos en lenguaje natural. Pides lo que tienes en la cabeza con un simple prompt y el sistema te monta la estructura visual. Así de simple.

Y es que el equipo de desarrollo ha introducido un concepto de lo más curioso: el «vibe design». ¿De qué va esto? Básicamente, el diseñador o emprendedor solo tiene que comunicar intenciones comerciales, objetivos de negocio o las sensaciones que busca transmitir. En lugar de trazar la interfaz paso a paso, le dices a la IA: Necesito una app de finanzas que transmita seguridad extrema y tenga un panel minimalista.

También te puede interesar:Nuevo Agente de Imágenes en Google Stitch, la Plataforma IA que Crea Apps con Solo Pedirlas

Como era de esperar, la inteligencia artificial asume todo el trabajo sucio. Se bebe esas descripciones vagas o emocionales y las convierte en interfaces reales y tangibles listas para usar. Esto acelera el proceso creativo de una manera brutal, ya que permite iterar docenas de ideas en cuestión de minutos sin sufrir los habituales cuellos de botella del diseño clásico.

Un lienzo infinito con soporte de voz y agentes paralelos

Por si fuera poco, la interfaz no se queda limitada a una aburrida caja de chat. Han incorporado un inmenso lienzo infinito donde puedes ir organizando y evolucionando tus conceptos, desde el boceto más rudimentario hasta prototipos complejos de alta fidelidad. El motor detrás de esto es un todoterreno. Acepta como entrada de contexto tanto texto, como imágenes de referencia o fragmentos de código fuente.

Pero la verdadera magia aparece cuando decides soltar el teclado y encender el micrófono. Stitch incluye ahora un avanzado soporte de voz para interactuar de forma natural durante toda tu sesión de trabajo. Imagina estar debatiendo en voz alta con tu ordenador sobre por qué un menú lateral no termina de encajar. La IA aplicará los cambios dinámicamente y hasta te ofrecerá críticas constructivas en tiempo real, tal y como detallan en una publicación de su blog. Tu nuevo socio creativo no descansa.

A ello se le suma una característica vital para los estudios que manejan mucho volumen de trabajo: un administrador de agentes integrado. Esta función te permite tener varios hilos de diseño o ideas alternativas trabajando en paralelo. Puedes explorar tres paletas de colores distintas de una misma aplicación sin que el proyecto general se convierta en un caos inmanejable.

También te puede interesar:Nuevo Agente de Imágenes en Google Stitch, la Plataforma IA que Crea Apps con Solo PedirlasExportación, interactividad inmediata y cero fisuras

Si miramos las entrañas técnicas, la interoperabilidad es sin duda otro de los platos fuertes. Stitch ahora soporta la lectura y escritura de archivos en formato Markdown. Es decir, puedes exportar e importar todas tus directrices de marca o reglas de componentes para llevarlas de un ecosistema a otro. Y si quieres exprimirlo al máximo, los resultados finales se pueden exportar directamente a plataformas de Google como AI Studio o Antigravity.

Evidentemente, de nada sirve una pantalla bonita si se siente como un PDF sin vida. Por eso, la herramienta de Google convierte instantáneamente tus diseños estáticos en prototipos interactivos navegables. Los creadores pueden enlazar las diferentes vistas y probar el flujo de usuario real con apenas un clic.

La sorpresa definitiva llega cuando te olvidas de diseñar un paso intermedio. Si el usuario toca un botón y no hay pantalla de destino, la IA genera automáticamente las vistas adicionales necesarias basándose en la lógica global de la aplicación. Te cierra el recorrido completo sin pedirte ayuda. Ni se inmuta ante los imprevistos.

De momento, esta pieza de ingeniería lleva la etiqueta de «experimental» dentro de la incubadora de Google Labs. Si te pica la curiosidad profesional y quieres comprobar de primera mano si cumple lo que promete, ya puedes trastear con ella directamente desde la web oficial. Veremos si la competencia reacciona a tiempo ante este órdago tecnológico. Si los modelos de lenguaje ya nos enseñaron a programar charlando, ahora nos van a enseñar a diseñar sin mover un solo píxel manualmente. La pelota está en el tejado de Figma.

Me dedico al SEO y la monetización con proyectos propios desde 2019. Un friki de las nuevas tecnologías desde que tengo uso de razón.

Estoy loco por la Inteligencia Artificial y la automatización.